Ett team av ingenjörer från MIT och Princeton University har utvecklat ett robotsystem som med hjälp av AI kan plocka upp valfritt objekt ur en back full med saker och lägga det i en annan, vilket är svårare än det låter när man är en robot.

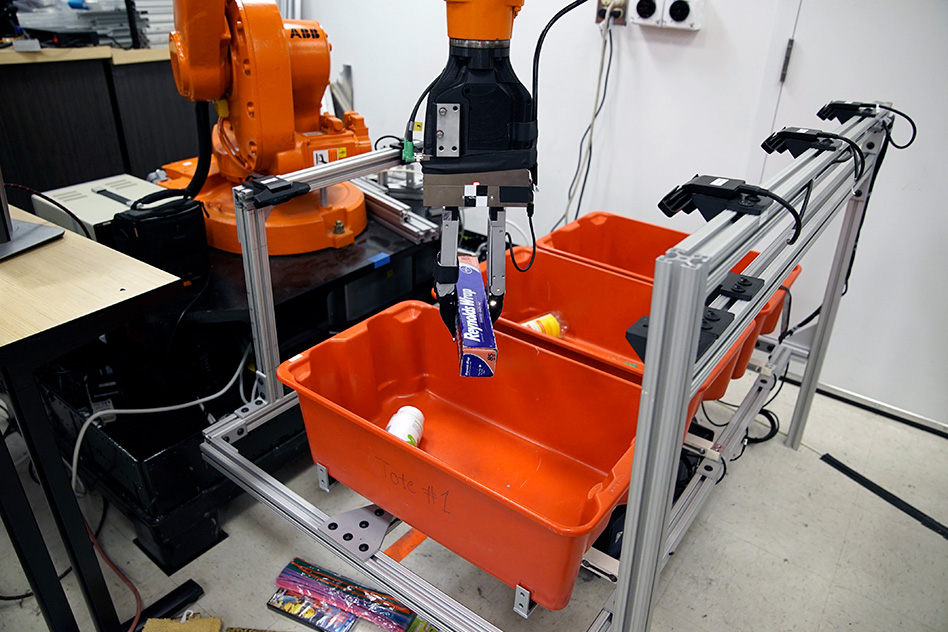

Robotsystemet består av en vanlig ABB-industrirobot som har försetts med ett specialanpassat gripdon. En uppsättning kameror används också för att identifiera och klassificera objekten som plockas upp av roboten. Till skillnad från hur de flesta andra går till väga vid denna typ av uppgifter plockar MIT:s robot först upp objektet för att därefter analysera vilken typ av objekt det handlar om. När objektet har separerats från de andra sakerna i backen är det nämligen lättare att identifiera.

”Detta kan appliceras på lagersortering, men kan även användas för att plocka saker ur ditt köksskåp eller lyfta undan bråte efter en olycka. Det finns många situationer där plocktekniker skulle kunna ha genomslag”, säger Alberto Rodriguez, professor i maskinteknik vid MIT.

Forskarna tränade roboten på att plocka olika objekt från en back där det även låg andra saker och använde sig både av gripdon och sugkopp samt både uppifrån och från sidan. Man visade även roboten bilder på backar med objekt som låg huller om buller och markerade de objekt som var plockbara och vilken sorts plockmetod som var lämplig respektive olämplig.

Efter hundratals exempel byggdes ett bibliotek upp över lyckade och misslyckade plockningar och på detta applicerade Rodriguez och hans team ett djupt neuralt nätverk (DNN). Med hjälp av detta kan roboten, enbart genom att titta på en back fylld med saker, förutse vilka objekt som är greppbara och om den ska använda gripklo eller sugkopp för att plocka upp dem samt från vilken angreppsvinkel.

För att lära roboten känna igen och klassificera objekt utvecklades ett perceptionssystem på ett liknande sätt med hjälp av ett bibliotek av produktbilder från bland annat nätbutiker. Därefter etiketterades varje produktbild manuellt och en algoritm utvecklades för att utifrån pixeldatan i bilderna knyta dem till en given etikett.

Forskarna demonstrerade denna teknik redan sommaren 2017 under Amazon Robotics Challenge där de vann i kategorin ”stowing” och tilldelades Amazon Research Award. Sedan dess har en del förbättringar gjorts, bland annat genom att robotens gripdon har försetts med taktila sensorer för att även kunna känna objekten den plockar upp.

”Gripdonet har nu taktila sensorer och vi har aktiverat ett system där roboten spenderar hela dagen med att kontinuerligt plocka saker från en plats till en annan. Den fångar upp information om när den lyckas och när den misslyckas och hur det känns att plocka upp, eller att misslyckas med att plocka upp objekt”, säger Rodriguez.